Video Boost mit Nachtsicht wurde im Oktober 2023 zusammen mit der Google Pixel 8-Serie angekündigt. Der Rollout begann einige Wochen später, und zwar nur für das „Pro“-Modell. Es handelt sich um eine Technologie, die KI nutzt, um die Videos, die Sie mit Ihrem Pixel-Gerät aufnehmen, deutlich zu verbessern.

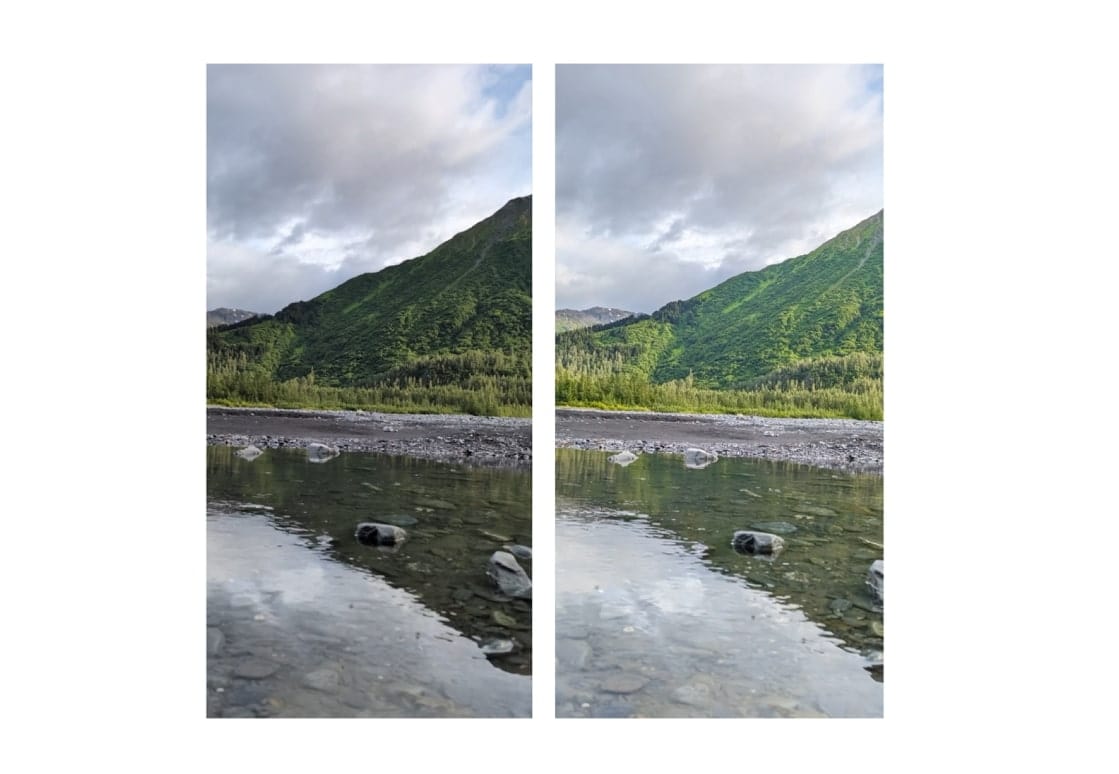

Die beiden Elemente der Technologie arbeiten zusammen und kümmern sich jeweils um unterschiedliche Aufgaben. „Video Boost“ konzentriert sich auf die Steigerung von Parametern wie Dynamikumfang, Kontrast, Farben, Stabilisierung und Detaillierungsgrad. Andererseits ist „Night Sight“ die Umsetzung der Funktion in Videos, die die Google Kamera-App schon seit langem für Fotos bietet.

In der neuesten Podcast-Folge „Made by Google“ gab das Unternehmen weitere Details zur Entwicklung von Video Boost mit Nachtsicht bekannt. Das Team verriet, was genau es mit dieser Technologie suchte. Sie erwähnten auch die größten Herausforderungen, denen sie auf ihrem Weg begegneten.

Googles Fokus bei der Entwicklung von Video Boost mit Nachtsicht

Das Hauptziel von Google war „Schalten Sie die beste Videoqualität frei, die Sie je auf einem Smartphone gesehen haben.“ Pixel-Geräte sind für ihre qualitativ hochwertigen Fotos bekannt, aber die Videoaufzeichnung war noch nie auf dem gleichen Niveau. Jetzt werden sie versuchen, die Qualität zwischen Foto und Video auf ihren Handys auszugleichen.

Bezüglich der Exklusivität der Funktion des Pixel 8 Pro sagten sie: „Wir beginnen gerade mit Pixel 8 Pro, um dies für unsere Benutzer zu tun.“ Obwohl es sich nicht um eine offizielle Bestätigung handelt, öffnet dies die Tür dafür, dass Video Boost mit Nachtsicht in Zukunft mehr Pixel-Geräte erreichen wird.

Die Herausforderungen, mit denen das Entwicklerteam konfrontiert war

Als Herausforderungen nannten sie die Rechenleistung von Smartphones. Ein wesentlicher Unterschied zwischen Night Sight für Fotos und Night Sight für Videos besteht in der Art der Verarbeitung. Während bei Fotos die Verarbeitung auf dem Gerät erfolgt, verlässt man sich bei Videos auf die Leistungsfähigkeit cloudbasierter KI. Denn für die komplexe lokale Videoverarbeitung mangelt es Smartphones noch an ausreichender Leistung.

Dies ist nicht verwunderlich, da diese Aufgabe selbst für Desktop-PCs kompliziert sein kann. Denken Sie daran, dass Videodateien exponentiell länger und komplexer sind als Fotos. Bezüglich der Nutzung der Cloud zur Videoverarbeitung sagte das Google-Team Folgendes:

„So können wir entscheiden, wie viele Frames wir ausrichten und zusammenführen möchten und wie wir sie zusammenführen. Wir können dies sogar auf eine andere Ebene bringen. Wir können es sogar noch viel besser machen. Wir können sogar komplexere Algorithmen gleichzeitig ausführen. Wir können zum Beispiel eine Unschärfe ausführen. Wir können eine Stabilisierung durchführen. Wir können eine Farbkorrektur durchführen.“

Die Nutzung der Cloud für die Verarbeitung bietet zwar den Vorteil, die volle Leistung der Google-Server nutzen zu können, bedeutet aber auch, dass Sie die Funktion nicht ohne Internetverbindung nutzen können.

Darüber hinaus bestand eine weitere große Herausforderung in der Kalibrierung der Verarbeitung, um jegliche Art von Problemen im Endergebnis zu vermeiden. Das heißt, sie mussten herausfinden, wie sie Zeitverzögerungen zwischen Audio und Video, chromatische Aberrationen, zufälliges Flimmern oder ähnliche Effekte vermeiden konnten. Schließlich möchte niemand ein Tool nutzen, das ständig unbrauchbare Ergebnisse liefert.