Der Boom für künstliche Intelligenz überraschte die Tech -Industrie. Die Implementierung von KI führte zu zahlreichen positiven Ergebnissen, wie z. B. erhebliche Fortschritte bei Schlüsseltechnologien und die Entwicklung beeindruckender Tools, die zuvor unmöglich schienen. Es brachte jedoch auch einige Herausforderungen, die Jahre später immer noch richtig angestrebt werden. Betrugsmethoden oder Täuschungen, die auf KI-betriebenen DeepFakes basieren, nehmen einen privilegierten Platz auf der Liste der besorgniserregendsten ein.

Eine der Haupttugenden von KI ist diejenige, die wiederum auch einen der größten Nachteile geschaffen hat. Wir sprechen über den Anstieg des Entwicklungstempos in der Tech -Branche. Dies ist zwar positiv für die Branche an sich, hat die Regulierungsbehörden in eine Bindung gesteckt. Dieselben KI -Unternehmen wurden auch in das Problem verwickelt, da nicht alle Tools verfügen, mit denen sie genau identifizieren können, wenn eine Datei eine DeepFake ist und den Benutzer benachrichtigt.

Was ist ein Deepfake?

Vielleicht sind Sie immer noch nicht ganz klar darüber, was eine Deepfake ist. Grundsätzlich ist es Inhalt, die von KI -Modellen erzeugt werden, in denen das Gesicht oder der Körper einer Person digital verändert wird, normalerweise durch Überlagern von jemand anderem. Auf diese Weise erscheint das Opfer in Situationen, in denen es sich nie befanden. Dies gilt auch für Audiodateien, bei denen böswillige Schauspieler jemandes Stimme „klonen“, damit sie sagen, was sie wollen.

In den richtigen Händen sind diese Arten von Werkzeugen sehr nützlich und ermöglichen es Ihnen, Ihre Kreativität in vollen Zügen auszunutzen. Da AI Deepfakes jedoch immer realistischer geworden sind, haben bösartige Schauspieler begonnen, sie für ihre Betrügereien zu verwenden.

Anfangs gab es offensichtliche Fehler in Bildern mit AI-generierten Bildern, die es leicht machten, sich mit dem menschlichen Auge zu identifizieren. Sie mussten sich nur Dinge wie die Finger ansehen; Ja, Hände zu zeichnen ist selbst für mächtige AIs schwierig. Da sich jedoch generative KI -Modelle entwickelt haben, ist die Ausgabe zunehmend realistischer geworden. Heute sind viele Ai-generierte Bilder von der Realität nicht zu unterscheiden. In der Tat könnten wir sagen, dass Sie mit AI-generiertem Kunstwerk leichter identifizieren können als ein fotorealistisches Bild oder ein Video mit AI-generiertem.

DeepFake -Tools stehen jetzt allen zum Guten und zum Schlechten zur Verfügung

Als ob das nicht genug wäre, sind Unternehmen nicht nur mit Tools für Bildgeneration zufrieden. In den letzten Jahren haben wir sogar Modelle der Videogeneration mit beeindruckenden Ergebnissen gesehen. In diesem Monat stürzte Bytedance-Parent Company of Tiktok-ein KI-Video-Generation-Modell mit den realistischsten Ergebnissen, die wir je gesehen haben. Das Modell, das Omnihuman-1 genannt wird, verspricht Video-Deepfakes bis zu 10x besser als zuvor. Wir sprechen von einem unglaublichen Qualitätssprung in der Qualität und wir werden jedes Jahr solche Dinge sehen. Im Folgenden können Sie ein kleines Beispiel dafür sehen, wozu Omnihuman-1 fähig ist.

China ist auf 🔥 Bytedance fallen ein weiteres Banger -AI -Papier!

Omnihuman-1 kann realistische menschliche Videos auf jedem Seitenverhältnis und dem Körperanteil mit nur einem einzigen Bild und Audio erzeugen. Dies ist das Beste, was ich bisher gesehen habe.10 unglaubliche Beispiele und der Forschungsarbeitslink👇 pic.twitter.com/5ojnj0797t

– Ashutoshshrivastava (@ai_for_success) 4. Februar 2025

Verbesserte Deepfakes und KI -Tooldemokratisierung haben dazu geführt, dass mehr Menschen diese Plattformen nutzen. Die Schüler können sie nützlich finden, um ergänzende Bilder für Projekte oder Präsentationen zu erhalten. Künstler können sich inspirieren lassen, um daran zu arbeiten. Sie können ein Bild generieren, nur um Spaß mit Freunden zu haben.

Aber was passiert, wenn böswillige Schauspieler ins Spiel kommen? Täuschung, Manipulation, Erpressung… im Grunde genommen alle Formen von Betrügereien, die bereits existierten, aber durch KI -Deepfakes viel einfacher wurden.

Vorfälle im Zusammenhang mit AI-betriebenen Deepfake-Betrugsversuchen

Es gab unzählige Fälle von Betrug in mehreren Kontexten, in denen KI -Deetagonisten die Protagonisten waren. Ähnlichem. Zu den jüngsten Fällen gehört die Förderung von Aktien oder Krypto -Vermögenswerten mit dem Gesicht und der Stimme des Investors Vijay Kedia. Es ist auch sehr häufig, Elon Musks Bild in Videos zu verwenden, in denen er angeblich eine Kryptowährung fördert. Praktisch jeder gehackte YouTube -Kanal zeigt dasselbe Video mit „Elon Musk“, der versucht, Menschen zu betrügen, indem sie Geld oder Kryptos anfordern.

Ein weiteres wichtiges Risiko im Zusammenhang mit DeepFakes ist die potenziellen Fälle von Sextortion. Dies ist eine Praxis, bei der böswillige Dritte gefälschte Akte schaffen, um die Menschen zu erpressen, indem sie droht, sie öffentlich zu verbreiten oder sie an ihre Familien zu schicken. Jugendliche sind normalerweise das Hauptziel dieser Situationen, da sie in sozialen Netzwerken eher mit Fremden interagieren. Plattformen wie Instagram haben Maßnahmen ergriffen, um zu versuchen, diese Art der Interaktion zu stoppen. Die Exposition des Teenagers beginnt jedoch in dem Moment, in dem sie sich entscheiden, mit einem Fremden in den sozialen Medien zu chatten.

Es gibt auch diejenigen, die Deepfakes verwenden, um zu versuchen, die öffentliche Meinung zu manipulieren. Diese Fälle haben normalerweise mehrere Ursprünge, obwohl sie häufig aus der politischen Sphäre abfließen. Zum Beispiel können schlechte Schauspieler Videos manipulieren, um die Abstimmung für oder gegen einen Kandidaten bei einer Wahl zu fördern. Diese Videos können versuchen, einen bestimmten Kandidaten schlecht aussehen zu lassen, oder im Gegenteil, dass er in den Augen der Menschen extrem gut aussieht.

In ähnlicher Weise gibt es Fälle, in denen Menschen DeepFake -Bilder oder -Videos als Werkzeug verwenden, um Hass zu verbreiten. Es gibt Fälle von manipulierten Multimedia, um zu versuchen, eine Abnehme gegen eine bestimmte Gemeinschaft oder Gruppe zu schaffen. Diese Videos können den Leuten zeigen, dass sie etwas sagen, das sie nie gesagt haben oder Dinge tun, die sie nie getan haben.

Identitätswechsel ist dank der Kraft der Deepfake eine weitere Möglichkeit in der KI -Ära. Exikble.ai listet einen Fall von Mitte Februar auf, in dem Betrüger legitime Anspruchshalter ausgab. AI -Tools ermöglichten es ihnen, realistische Videos zu erstellen, die sich als andere ausgeben und es ihnen ermöglichten, Vermögenswerte in Höhe von rund 5,6 Millionen US -Dollar zu stehlen. In diesem Fall hatten die Betrüger auch einige personenbezogene Daten der Opfer, die wahrscheinlich durch Social Engineering erhalten wurden. Daher kombiniert dieses Szenario das Risiko von Deepfakes mit der Notwendigkeit, alle Ihre persönlichen Daten zu schützen.

Menschen suchen zunehmend nach Möglichkeiten, Deepfakes zu erkennen

Es gibt unzählige Fälle, in denen Deepfakes verwendet werden, um zu versuchen, zu täuschen, zu betrügen oder zu bedrohen. Daher sollten die Menschen immer vorsichtiger über die Multimedia -Inhalte sein, die sie im Internet sehen. Tatsächlich spiegelt sich die steigende Besorgnis bereits in Statistiken wider. Online -Suche im Zusammenhang mit “Deepfake -Bilder”Erhöhte sich im Jahr 2024 um 15% weltweit. Die Spikes traten kurz nach Nachrichten über Scherzen oder Betrug mit AI-betriebenen Videos oder Bildern auf. Einige der beliebtesten verwandten Suchbegriffe waren “So erfassen Sie Deepfake -Bilder“ Und „Real vs. Ai-generierte Bilder. ““ Die wachsende Sorge der Menschen ist also real.

Versuche, Scherzen oder Betrügereien auf der Grundlage von AI -Deepfakes basieren, dürften erst von jetzt an zunehmen. Heutzutage haben sogar Smartphones Apps, mit denen diese Art von Inhalten generiert werden kann. Außerdem ist das Smartphone selbst ein Gerät, das die Verbreitung manipulierter Videos oder Bilder erleichtert. Dies macht es im Zeitalter der künstlichen Intelligenz zu einem zweischneidigen Schwert.

Sogar du könntest als „schlechter Schauspieler“ – ohne wirklich eins – auftreten. Es ist nicht erforderlich, dass Sie eine bestimmte DeepFake -Datei erstellen. Alles, was Sie tun müssen, ist ein manipuliertes Bild, ein Video oder ein Audio zu erhalten und es mit Ihren Kontakten oder in Ihren sozialen Netzwerken zu teilen, als ob es real wäre. Dies ist oft nicht zu 100% Ihre Schuld, da DeepFake -Inhalte, wie wir bereits sagten, äußerst realistisch sein kann.

Um Fälle zu vermeiden, in denen Sie als „Deepfake-Diseminator“ fungieren, ohne es zu wissen oder auf potenzielle Betrügereien fallen, die von schlechten Akteuren gefördert werden-was sogar Ihre Sicherheit gefährdet könnte-müssen sich auf die AI-fokussierte Unternehmen handeln. Schließlich bieten sie die Tools an, um diese Art von Inhalten zu erstellen. Sie haben also auch die intrinsische Verantwortung, die Möglichkeiten zu erleichtern, es zu erkennen.

„Inhaltsanmeldeinformationen“ und „synthid“ versuchen, die Transparenz im Zeitalter der generativen KI zu steigern

Die Tech -Industrie ist angesichts dieser Situation nicht statisch geblieben. Die wachsenden unerwünschten Vorfälle im Zusammenhang mit Deepfakes führten zur Geburt der Koalition für Inhaltsproduktion und Authentizität (C2PA). Aus diesem fraglichen Ausschuss wurde „Inhaltsanmeldeinformationen“ geboren, ein Standard, der in der Ära der generativen KI Transparenz sucht. „Inhaltsanmeldeinformationen“ integriert und identifiziert spezifische Metadaten für Ai-Manipulierte Bilder, um sie als solche zu identifizieren.

Dies klingt zwar einfach und schnell zu implementieren, aber es war noch nicht so weit. Dies liegt daran, dass sowohl Gerätehersteller als auch KI -Entwickler den Standard einnehmen müssen. Das macht den Prozess langsam, insbesondere im Vergleich zum Tempo der Entwicklung künstlicher Intelligenzkapazitäten. Letztes Jahr startete Sony die Alpha 1 II -Flaggschiffkamera mit Unterstützung für Inhaltsanmeldeinformationen. Die neueste Samsung Galaxy S25 -Serie ist ebenfalls mit dem Standard kompatibel.

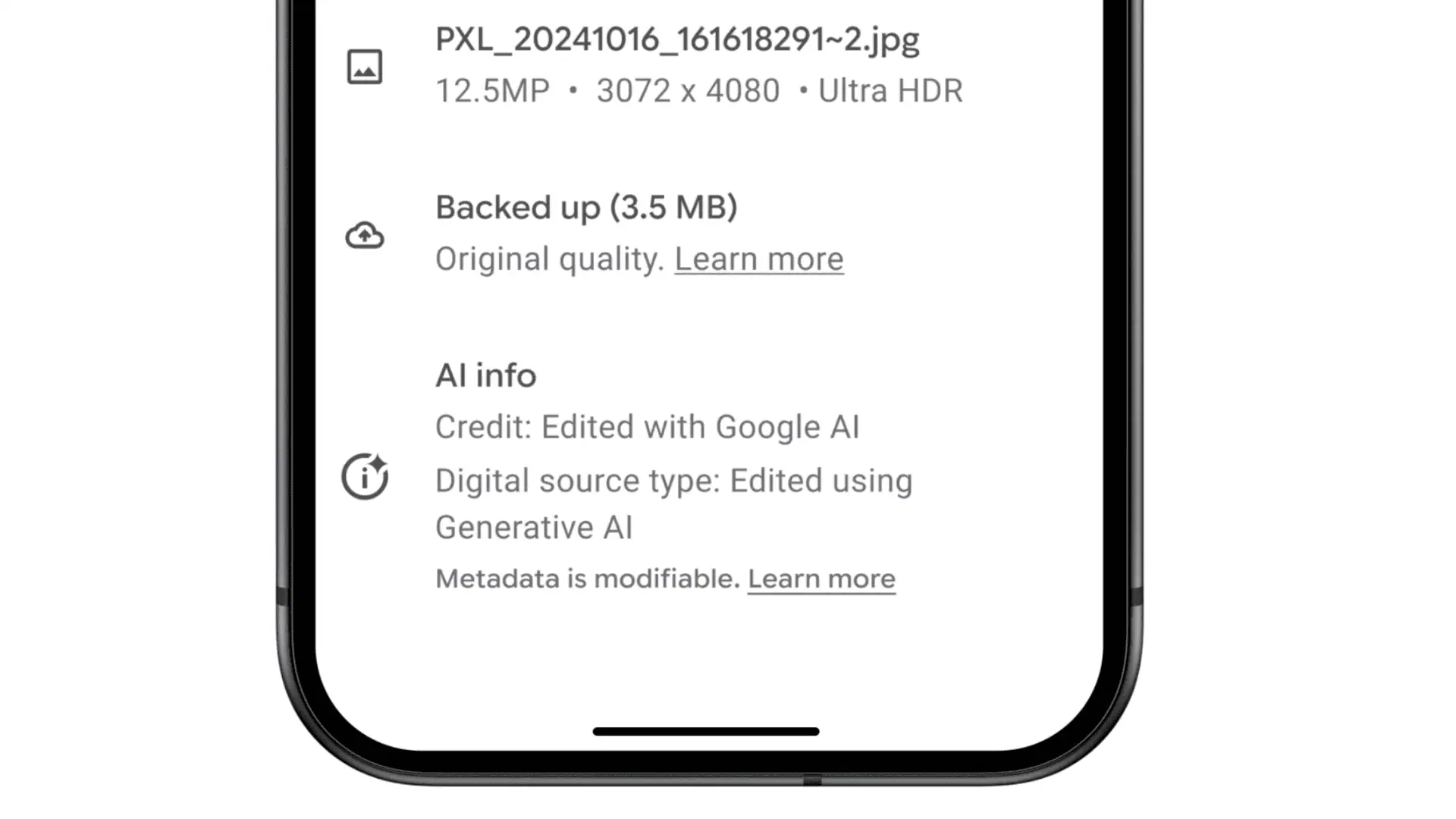

Mitte September 2024 kündigte Google seinen Eintritt in das C2PA-Komitee an. Der Mountain View -Riese wird seine Ressourcen und seine Erfahrung dazu beitragen, die Tools zu erweitern, die die Transparenz in der KI -Ära erleichtern. Google hat „synthid“ als eigenes System, um bearbeitete Inhalte mithilfe von KI-betriebenen Tools zu identifizieren. Tatsächlich kündigte das Unternehmen in diesem Monat an, dass Fotos, die durch „Reimagine“ generiert wurden, die Funktion in der Magic Editor Suite von Google Photos, ein synthides KI -Wasserzeichen aufweisen wird. Das „AI Watermark“ wird im Abschnitt „AI Info“ im Bereich der Foto-/Video -Details erhältlich sein.

Synthid ist jedoch ein weniger fähiger Standard als Inhaltsanmeldeinformationen. Derzeit hat Samsung in der Smartphone -Branche Transparenz in Bezug auf DeepFakes durch die Integration von Inhaltsanmeldeinformationen nativ übernommen. Bisher hat dies keine andere Telefonmarke getan, also ist es ein großer Schritt. Es bleibt abzuwarten, ob Content -Anmeldeinformationen über Software -Updates auf ältere Galaxy -Geräte kommen werden.

Tipps, um zu vermeiden, sich auf einen AI Deepfake -Betrug zu verlieben

Während viele Deepfakes möglicherweise nicht von der Realität zu unterscheiden sind, gibt es einige Schritte, die Sie selbst unternehmen können, um es zu vermeiden, dass sie ihnen zum Opfer fallen. Die erste besteht darin, den Medieninhalten mit öffentlichen Zahlen skeptisch zu bleiben. Wenn ein Schauspieler eine gefälschte Kryptowährung oder ein Politiker in einer surrealen Situation befindet, sollte Ihre erste Reaktion darin bestehen, die Authentizität der Datei zu bezweifeln.

Wenn der Inhalt angeblich aus einer bestimmten öffentlichen Figur stammt, überprüfen Sie ihre Social -Media -Handles. Oft stammen Videos öffentlicher Persönlichkeiten aus ihren eigenen Social -Media -Konten. Wenn Sie den Inhalt in ihren Social -Media -Konten nicht finden können, bleiben Sie wachsam. Sie sollten auch die Identifizierungsfunktionen von KI -Inhalten auf Ihrem Gerät und Apps aktivieren. Es gibt Fälle, in denen diese Tools standardmäßig aktiviert sind, aber auch andere, in denen sie nicht sind.

Schließlich gibt es auch DeepFake -Erkennungswerkzeuge, an die Sie sich wenden können. Während sie gelegentlich scheitern können, sind sie normalerweise sehr effektiv. Es gibt mehrere ähnliche Plattformen, sowohl öffentlich als auch exklusiv für ein bestimmtes System oder eine bestimmte Hardware. Deepware Scanner ist eine, die Sie von einem Browser von selbst frei verwenden können. Andere, wie Duckduckgoose, Intel Fakecatcher und Reality Defender, sind im Vordergrund für Unternehmen konzipiert.

Kurz gesagt, AI-betriebene DeepFakes sind hier, um zu bleiben, aber das ist nicht unbedingt eine schlechte Sache. Die beeindruckenden Fähigkeiten der künstlichen Intelligenz sind auch sehr nützlich, um die Produktivität zu steigern, zusätzliche Inspiration zu suchen, den Workflow zu optimieren, Zeit zu sparen und Ihre Kreativität zu entfesseln. Sie sollten sich jedoch des Kontextes bewusst sein, in dem wir uns befinden, und wachsamer darüber, wie Sie mit den Inhalten umgehen, die Sie im Internet konsumieren.

Hoffentlich übernehmen KI -Entwickler und Entwickler von KI -Tools Standards wie Inhaltsanmeldeinformationen. Dies wäre eine große Hilfe für die breite Öffentlichkeit, insbesondere die weniger technisch versierte.