Die Keynote zur Google I/O 2024 liegt hinter uns und Google hatte während der Show viel zu sagen. Die Keynote dauerte etwa zwei Stunden und Android war nur ein kleiner Teil davon. Google wird morgen separat mehr über Android sprechen, daher werden wir das dem Artikel hinzufügen, wenn es soweit ist. Im Moment konzentrieren wir uns auf die Keynote zur Google I/O 2024, und das ist genug, glauben Sie mir. Google hat viel geredet, da KI 121 Mal erwähnt wurde. Das hat niemanden wirklich überrascht, aber was die Leute überrascht hat, ist die Tatsache, dass Google die Informationen tatsächlich gezählt und ganz am Ende der Keynote geteilt hat. Der CEO des Unternehmens scherzte sogar darüber, da er wusste, dass da draußen jemand mitzählte. Lassen Sie uns auf jeden Fall gleich loslegen. Wir werden hier kurz auf neue Ankündigungen zur Google I/O 2024 eingehen und bei Bedarf auf spezielle Artikel verlinken. Neue Ankündigungen finden Sie nach Überschriften getrennt.

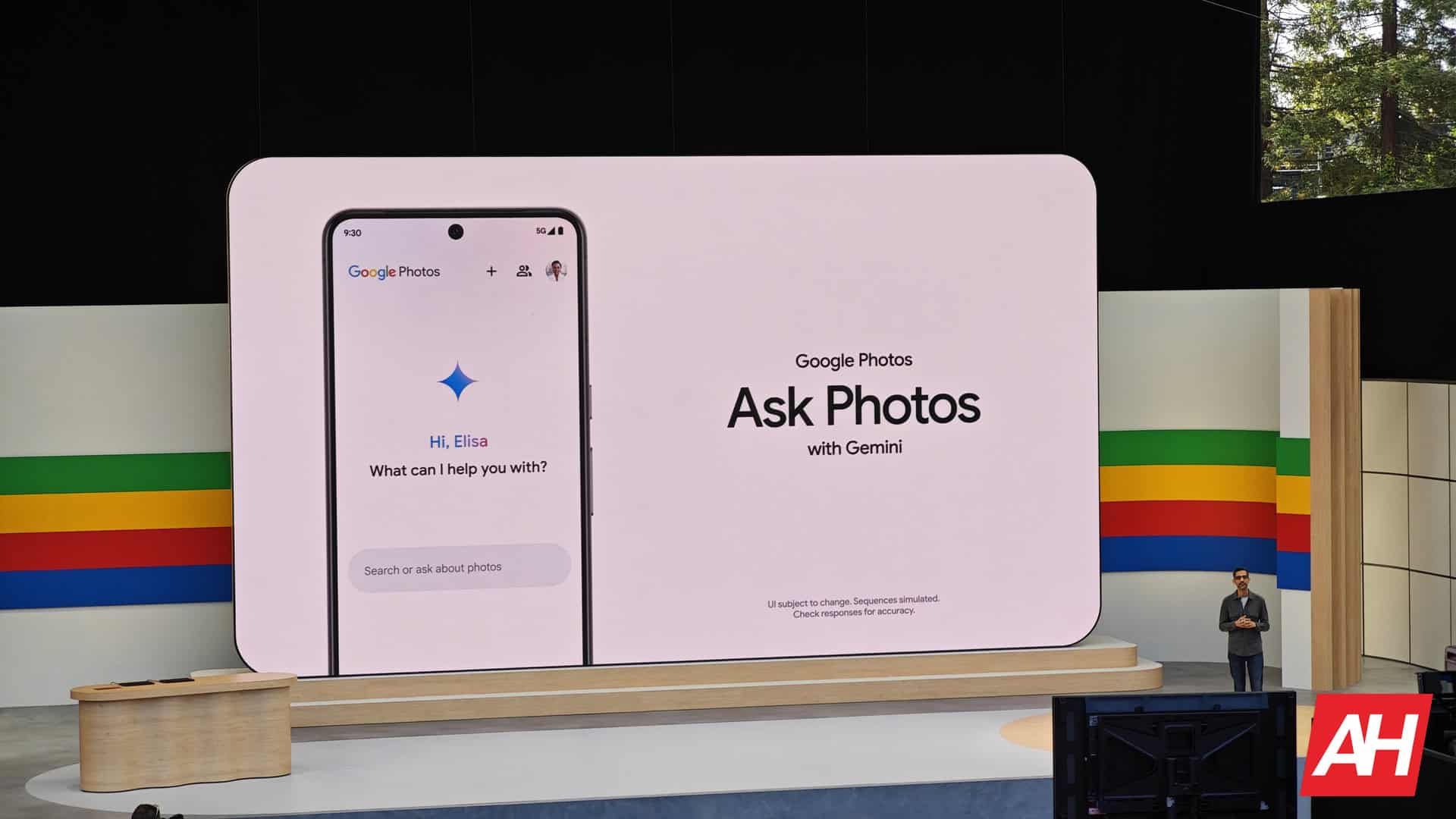

Die Suche in Google Fotos wird dank „Ask Photos“ intelligenter

Google hat während der Keynote eine neue Funktion für Google Fotos angekündigt, die Funktion „Fotos fragen“. Mit dieser Funktion können Sie Bilder wesentlich präziser finden. KI wird ein Teil davon sein und soll die Suchfunktion in Google Fotos deutlich nützlicher machen. Die Option wird in der unteren Leiste angeheftet und die Ergebnisse basieren nicht nur auf dem Ort, an dem die Fotos aufgenommen wurden. Zwillinge werden ihr Urteilsvermögen nutzen, um Ihnen zu zeigen, was relevant ist.

KI-Übersichten erreichen eine Milliarde Menschen

Die KI-Übersichtsfunktion wird es tun einer Milliarde Menschen zugänglich gemacht werden in der Google-Suche bis Ende 2024. KI-Übersichten, für diejenigen unter Ihnen, die es nicht wissen, sind als „Search Generative Experience“ bekannt. Die Funktion steht Benutzern in den USA zur Verfügung und wird bald auch im Rest der Welt eingeführt. Oben in vielen Suchergebnissen wird Ihnen eine von der KI erstellte Zusammenfassung angezeigt.

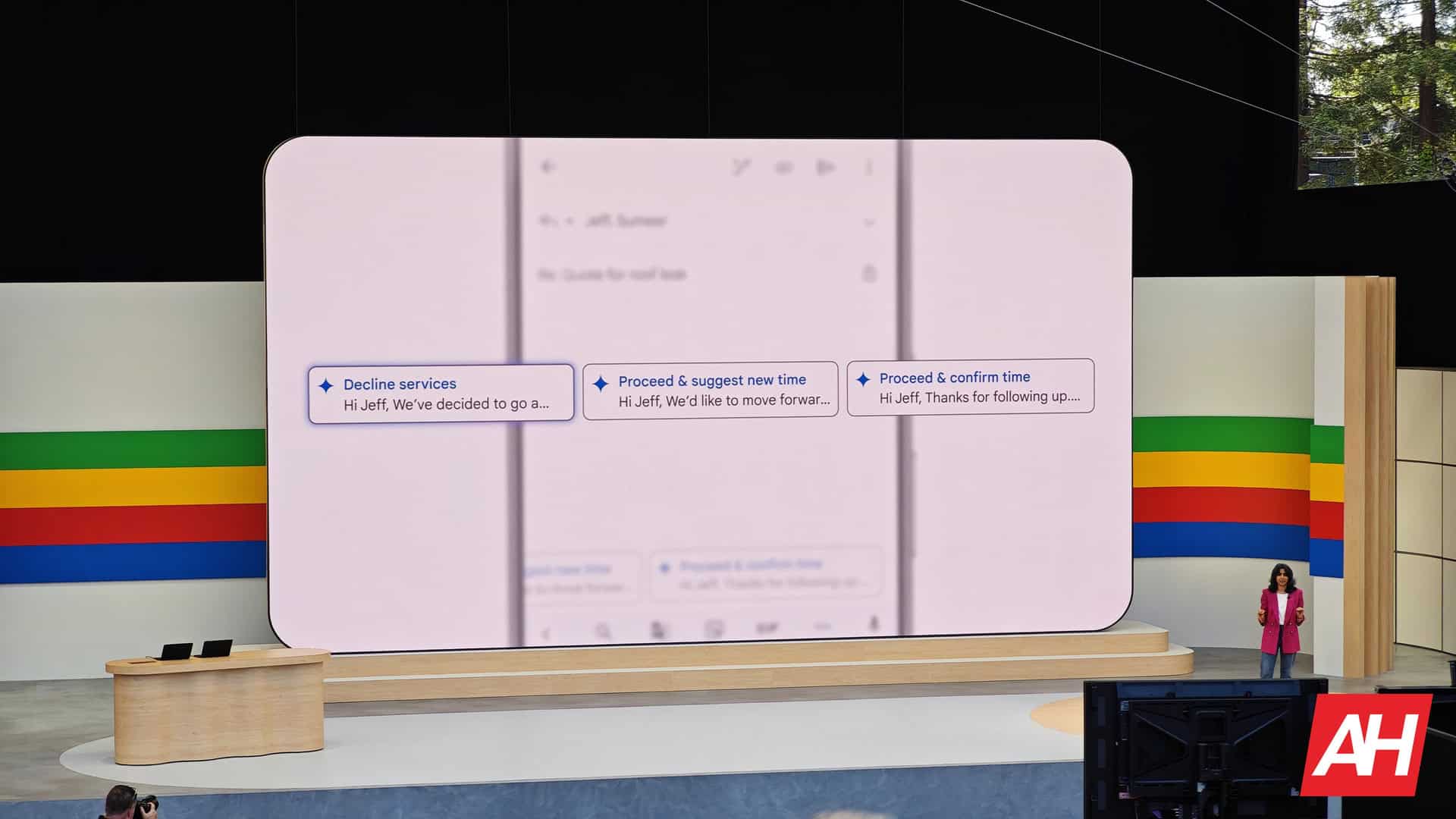

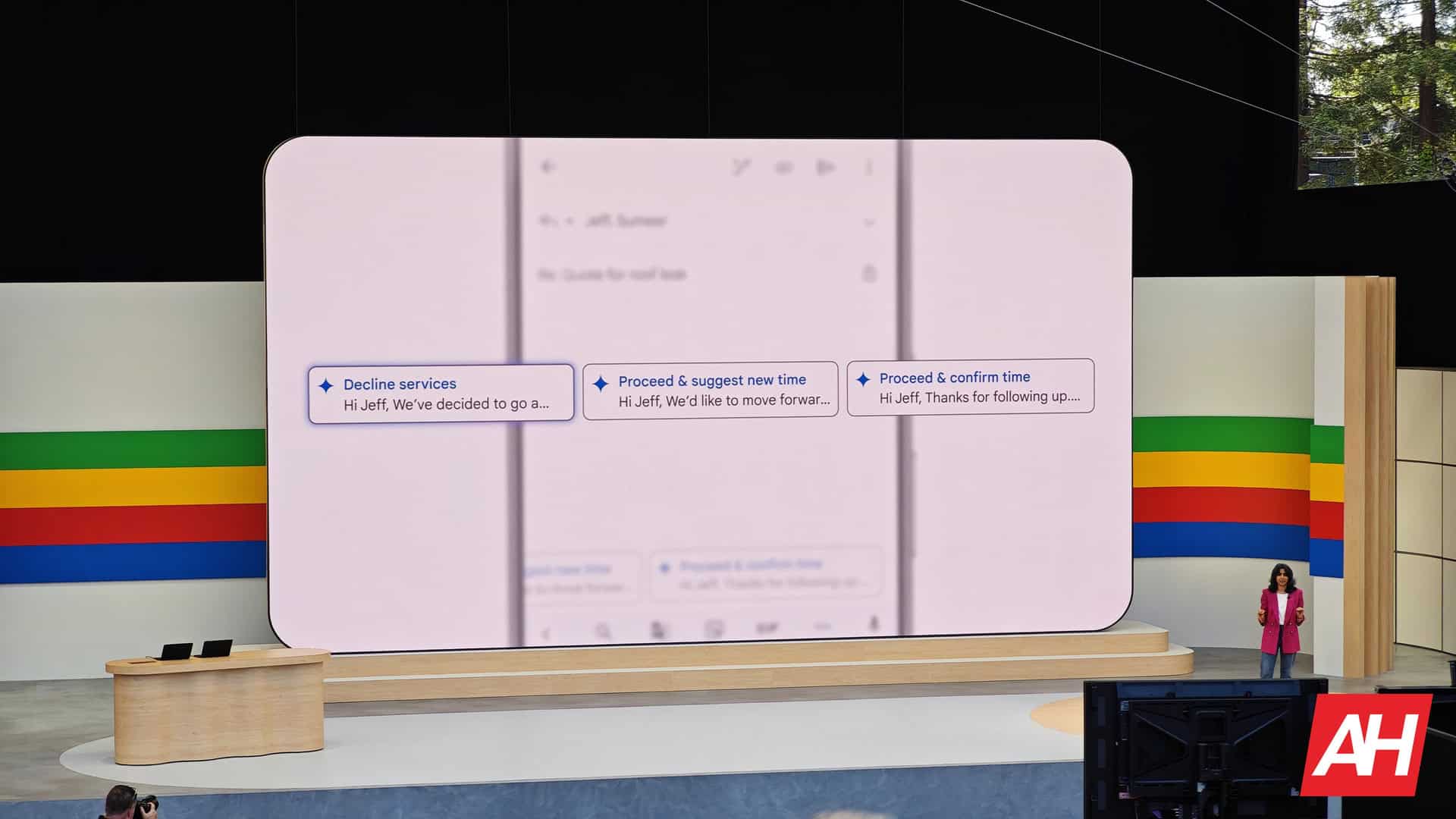

Gemini AI-Funktionen kommen für Gmail

Google bringt Gemini-KI-Funktionen in Gmail ein und macht den Dienst damit intelligenter. Das Unternehmen kündigte die Einführung dreier Funktionen an. Mit der Funktion „Zusammenfassen“ können längere Threads zusammengefasst werden. Die Funktion „Gmail Q&A“ wird ebenfalls eingeführt, um E-Mails zu verstehen und weiterzuhelfen. Während „Contextual Smart Replies“ E-Mails durchsucht und individuellere und detailliertere Vorschläge liefert.

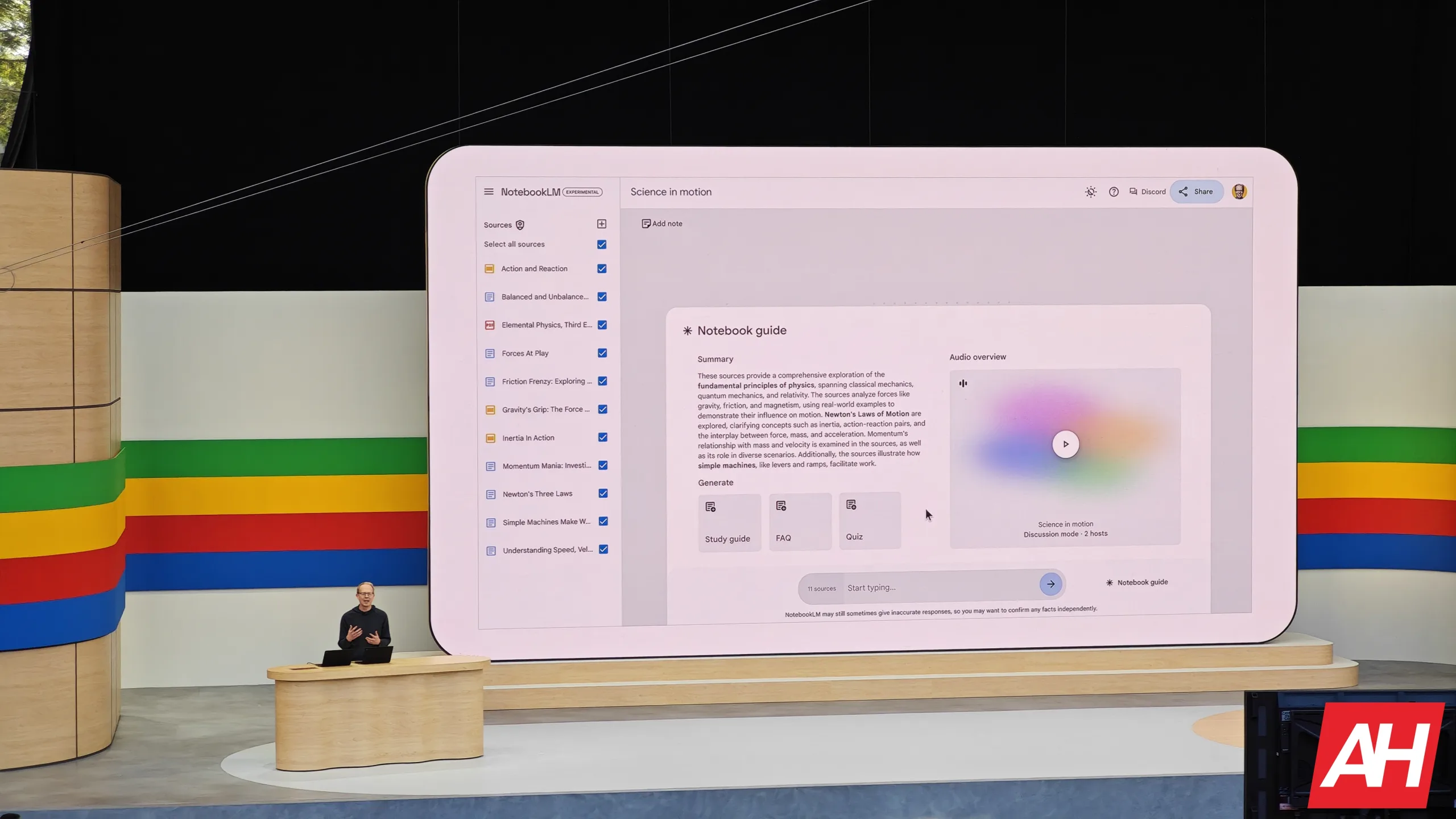

Gemini kommt zu NotebookLM

Gemini AI kommt auch zu NotebookLM. Es wird in der Lage sein, Audiodiskussionen basierend auf Textmaterial zu generieren. Dadurch können Studierende an der Sitzung teilnehmen, um sich Beispiele zum Kursinhalt anzueignen. Mit anderen Worten: Mit dieser Integration erhalten Studierende ein wirklich interaktives Lerntool.

Gemini 1.5 Pro verbessert und erweitert

Google gab bekannt, dass es Gemini 1.5 Pro sowohl verbessert als auch erweitert hat. Es wurde nun auf 1 Million Token für alle Entwickler weltweit erweitert. Es ist jetzt mit Gemini Advanced in über 35 Sprachen verfügbar. Das Unternehmen erweitert außerdem die Anzahl der Token auf 2 Millionen, allerdings in einer privaten Vorschau für Entwickler. Gemini 1.5 Pro wird auch in Google Workspace integriert, da es jetzt in Labs verfügbar ist.

Gemini 1.5 Flash, ein abgespeckter Gemini

Das Unternehmen sprach nicht nur über Gemini 1.5 Pro, sondern kündigte auch Gemini 1.5 Flash an. Dabei handelt es sich im Grunde um ein leichteres Modell des Gemini 1.5 Pro, wie Google es nannte. Es ist für Aufgaben optimiert, „bei denen niedrige Latenz und Kosten am wichtigsten sind“. Entwickler können es ab heute mit bis zu 1 Million Token in Google AI Studio und Vertex AI nutzen.

Project Astra, wahrscheinlich die coolste Demo, die wir heute gesehen haben

Google hat es geschafft, viele mit seiner Demo von „Project Astra“ zu überraschen. Dies ist im Grunde das neue Projekt von Google, bei dem es die Kameraschnittstelle nutzt und sie mit Gemini AI kombiniert, um sozusagen eine KI mit Augen zu schaffen. In der von Google geteilten Demo konnte sich die Person mit Gemini AI unterhalten, während sie mit der Kamera-Benutzeroberfläche herumlief und sie auf Dinge richtete. Die Person konnte einige Elemente markieren und Fragen dazu stellen oder basierend auf dem, was im Sucher angezeigt wurde, andere Antworten erhalten. Es ist eine Art Google-Konkurrenz für GPT-4o.

Imagen 3, das bisher fortschrittlichste Bilderzeugungsmodell

Im Rahmen der Keynote zur Google I/O 2024 kündigte Google außerdem Imagen 3 an. Dabei handelt es sich um das „bisher leistungsfähigste Bildgenerierungsmodell“ von Google DeepMind. Laut Google ist es in der Lage, die Art und Weise zu verstehen, wie Menschen schreiben, und fotorealistischere Bilder zu erstellen. Das Unternehmen sagte, dass es „Bilder mit unglaublichen Details, realistischer Beleuchtung und weniger störenden Artefakten produziert“.

Musik-KI-Sandbox, die die Musikerstellung vereinfacht

Google möchte Künstlern dabei helfen, Musik zu machen, und dafür gibt es Music AI Sandbox. Das Unternehmen hat sich mit einigen YouTubern zusammengetan, um zu demonstrieren, wie das funktionieren wird. Schöpfer können anfordern, dass ihnen bestimmte Muster auf eine bestimmte Art und Weise zur Verfügung gestellt werden, um sie beim Erstellen von Musik zu unterstützen. Basierend auf der Demo, es funktioniert wirklich gut. Google sagt auch, dass man „eng mit Musikern, Songwritern und Produzenten“ zusammengearbeitet habe, um dies zu erreichen.

Veo, ein neues generatives Videomodell

Dies ist auch Teil der Google DeepMind-Ankündigung. Es ermöglicht Benutzern das Erstellen und Bearbeiten von HQ-Videos mithilfe eines Texts, eines Bildes oder einer Videoaufforderung. Es ermöglicht die Erstellung von Videos mit einer Länge von über 60 Sekunden in verschiedenen visuellen Stilen. Wenn wir von hoher Qualität sprechen, meinen wir genau genommen 1080p-Clips. Hier ist ein Beispiel.

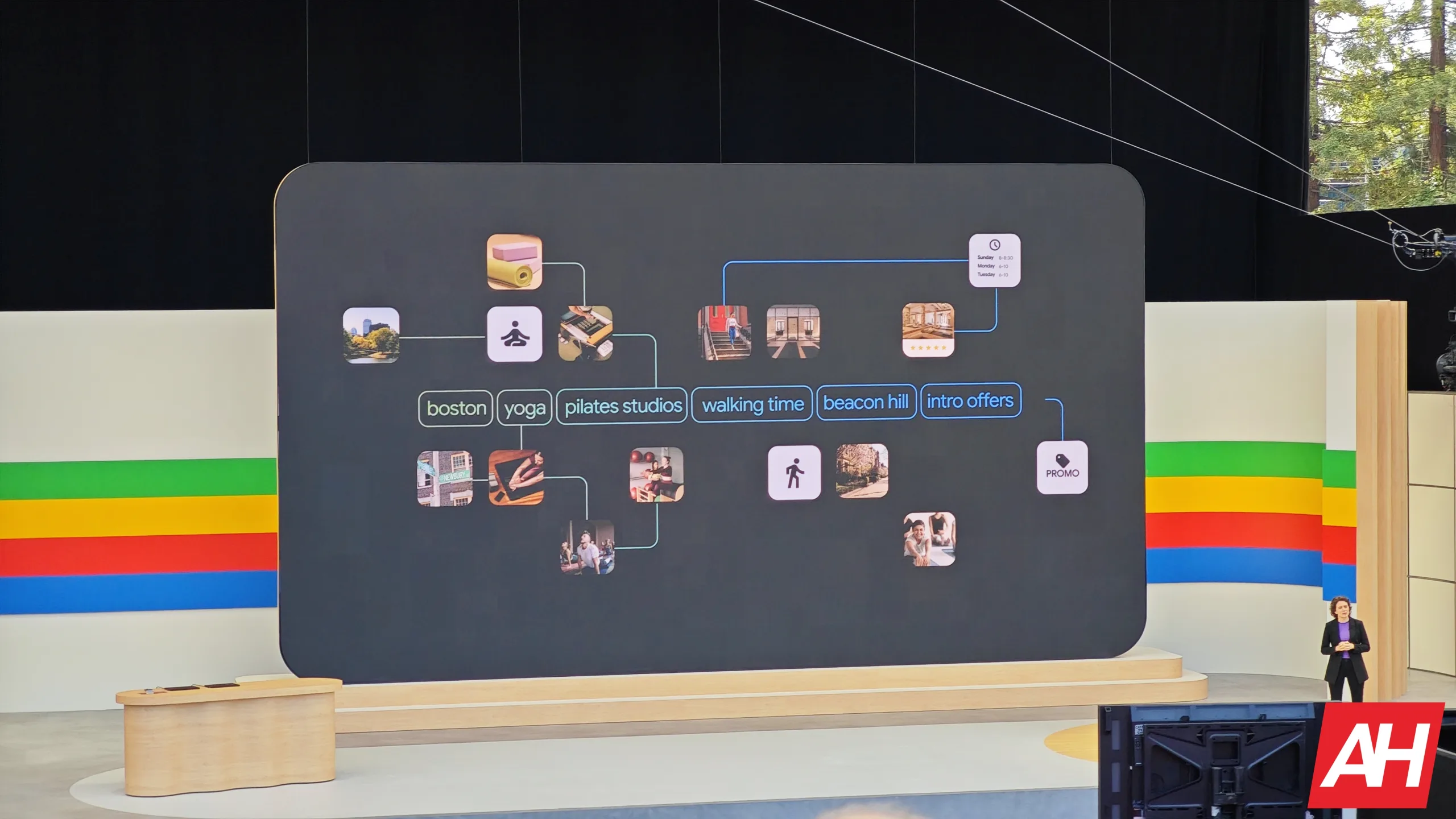

Gemini-gestützte Google-Suche

Google hat auch einen Schub für die Google-Suche angekündigt, natürlich dank Gemini AI. Google wird in Kürze „Funktionen zum mehrstufigen Denken“ in die Google-Suche einführen. Es wird im Wesentlichen in der Lage sein, Ihre Fragen in Teile zu zerlegen und herauszufinden, welche Probleme gelöst werden müssen. Google sagt, dass Sie dadurch viel Zeit bei der Recherche sparen könnten. Das Unternehmen kündigte außerdem an, dass Sie bald Fragen per Video direkt in der Google-Suche stellen können.

Verbesserte Kommunikation zwischen Workspace-Apps

Google hat angekündigt, die Kommunikation zwischen Workspace-Apps, Apps wie Gmail, Docs und Kalender zu verbessern. Gemini for Workspace wird die Sache noch besser machen, da es beispielsweise in der Lage sein wird, eine Quittung in Gmail zu erkennen und es Ihnen zu ermöglichen, sie in Drive und Sheets zu organisieren. Das ist nur ein Beispiel für einen schnellen Wechsel zu einer anderen Workspace-App. Gemini kann Ihre Ausgaben beispielsweise auch in Tabellen usw. analysieren. Es gibt viele Möglichkeiten.

Gemini „Gems“, eine Möglichkeit, maßgeschneiderte KI zu erhalten

Google bietet Ihnen grundsätzlich die Möglichkeit, Gemini AI anzupassen. Diese Funktion wird „in den kommenden Monaten“ verfügbar sein und es Ihnen ermöglichen, auf bestimmte Weise mit Gemini zu interagieren. Google nennt dies „Gems“. Sie können Zwillinge mit Persönlichkeiten und Fähigkeiten individuell gestalten. Wenn Sie es wünschen, können Sie es beispielsweise zu einem fröhlichen Fitnessstudio-Kumpel oder zu einem Freund mit tiefer Stimme machen. Das sind nur einige Beispiele.

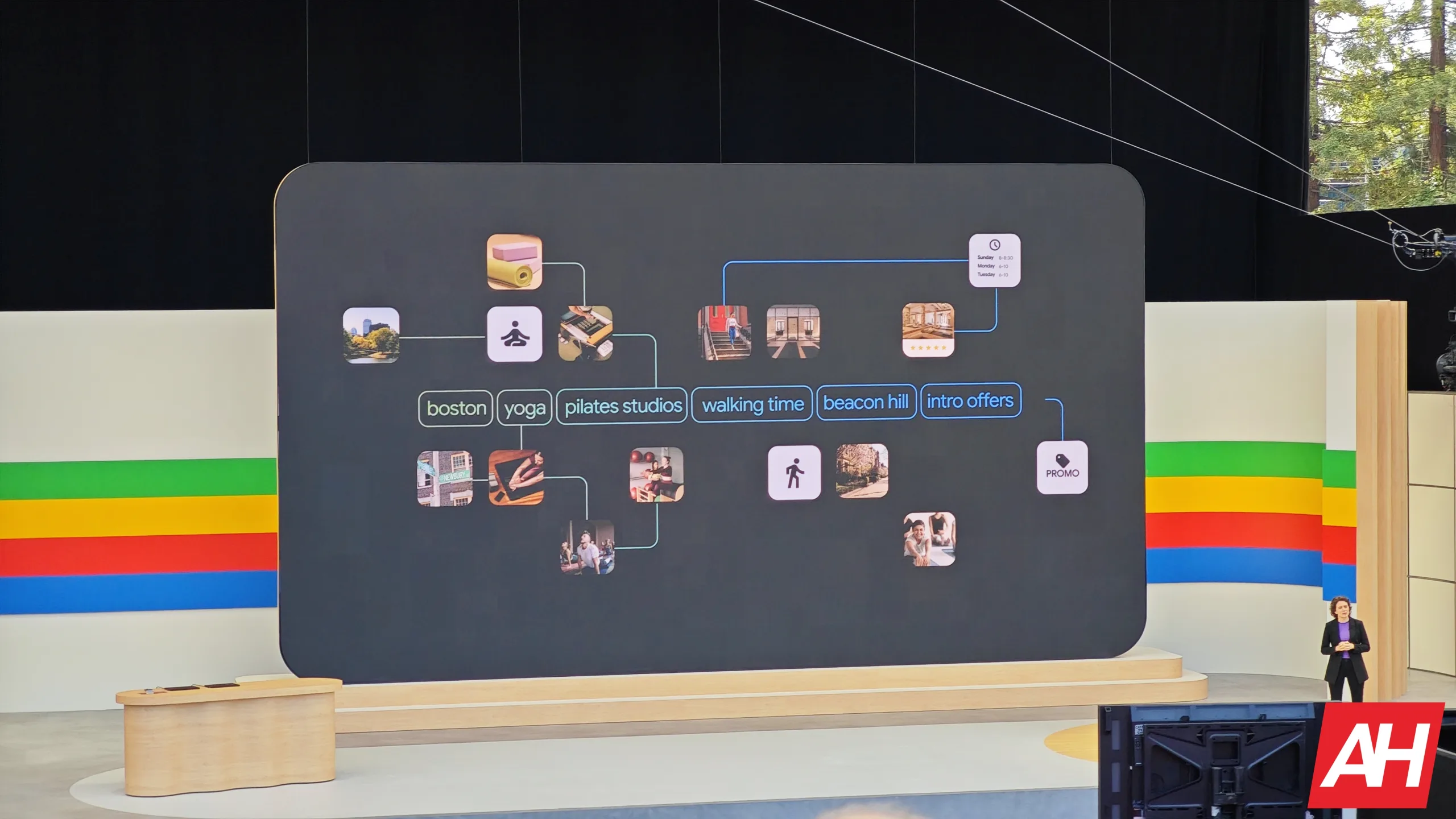

Android bekommt eine volle Dosis Gemini

Wie Sie bisher bemerkt haben, ist Gemini AI das A und O. Android bekommt seinen gerechten Anteil. Google wird mit Android 15 damit beginnen, Gemini direkt in Android zu integrieren. Das wird dazu beitragen, dass Android „hilfsbereiter und kontextbewusster“ wird. Dadurch werden auch Apps nützlicher. Google sagte außerdem, dass Sie später in diesem Jahr generierte Bilder per Drag-and-Drop in Google Messages und Gmail ziehen und auch Fragen zu bestimmten YouTube-Videos und PDFs stellen können.

Gemini Nano & Android

Laut Google kann Android dank Gemini Nano Sie während eines Anrufs warnen, wenn verdächtige Aktivitäten festgestellt werden. Darüber hinaus wird auch die Barrierefreiheitsfunktion von Android, TalkBack, dank Gemini Nano verbessert. Wie? Nun, Sie erhalten „klarere und ausführlichere“ Bildbeschreibungen.

SynthID für Video

Einige von Ihnen erinnern sich vielleicht an SynthID, das Google letztes Jahr angekündigt hat. Diese Funktion fügt im Wesentlichen nicht wahrnehmbare Wasserzeichen zu KI-generierten Bildern und Audiodaten hinzu. Das Gleiche wird auch mit Videoinhalten passieren, da Google die Funktionalität von SynthID erweitert. Dazu gehört natürlich auch Googles „Veo“-Modell.

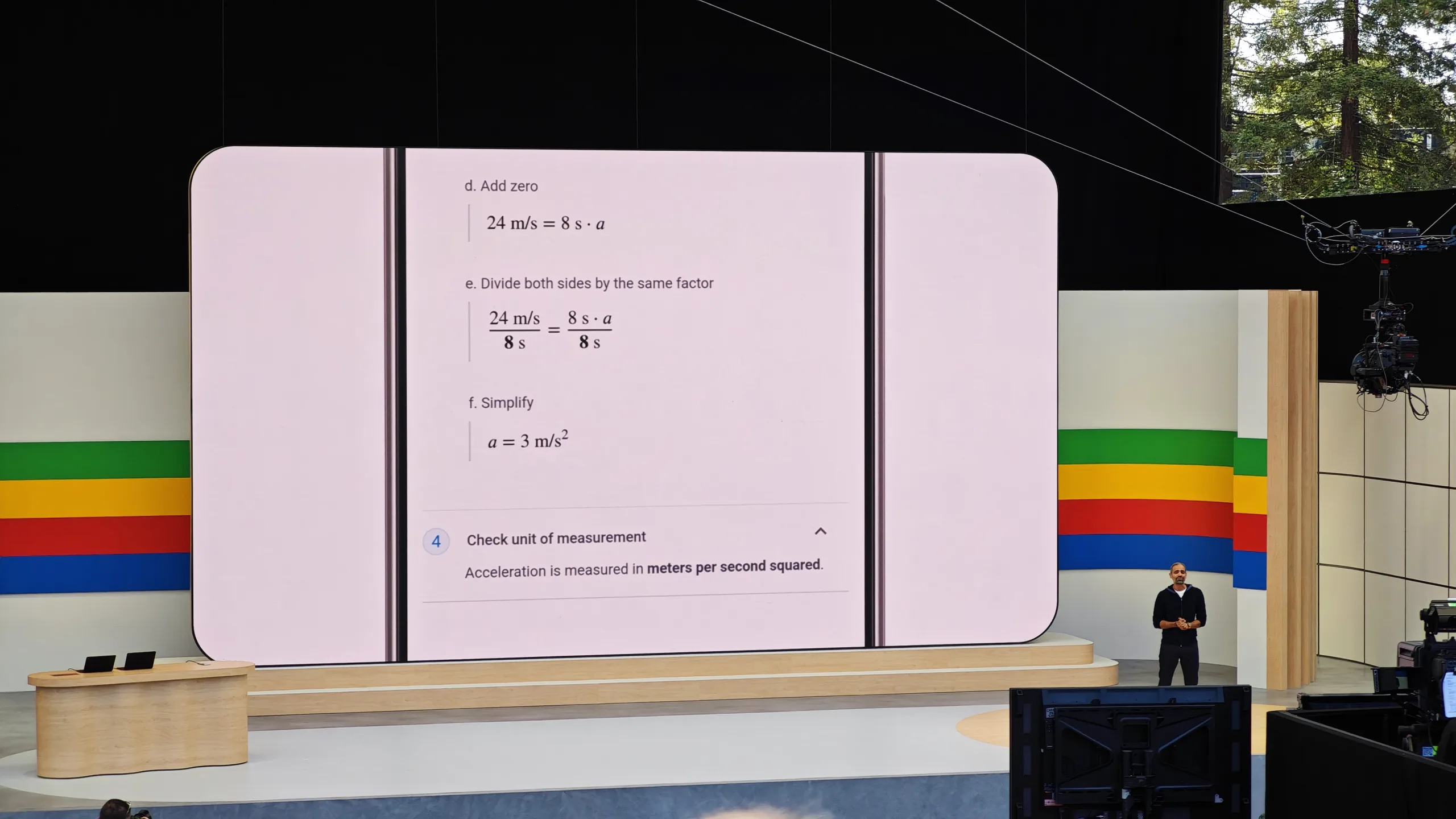

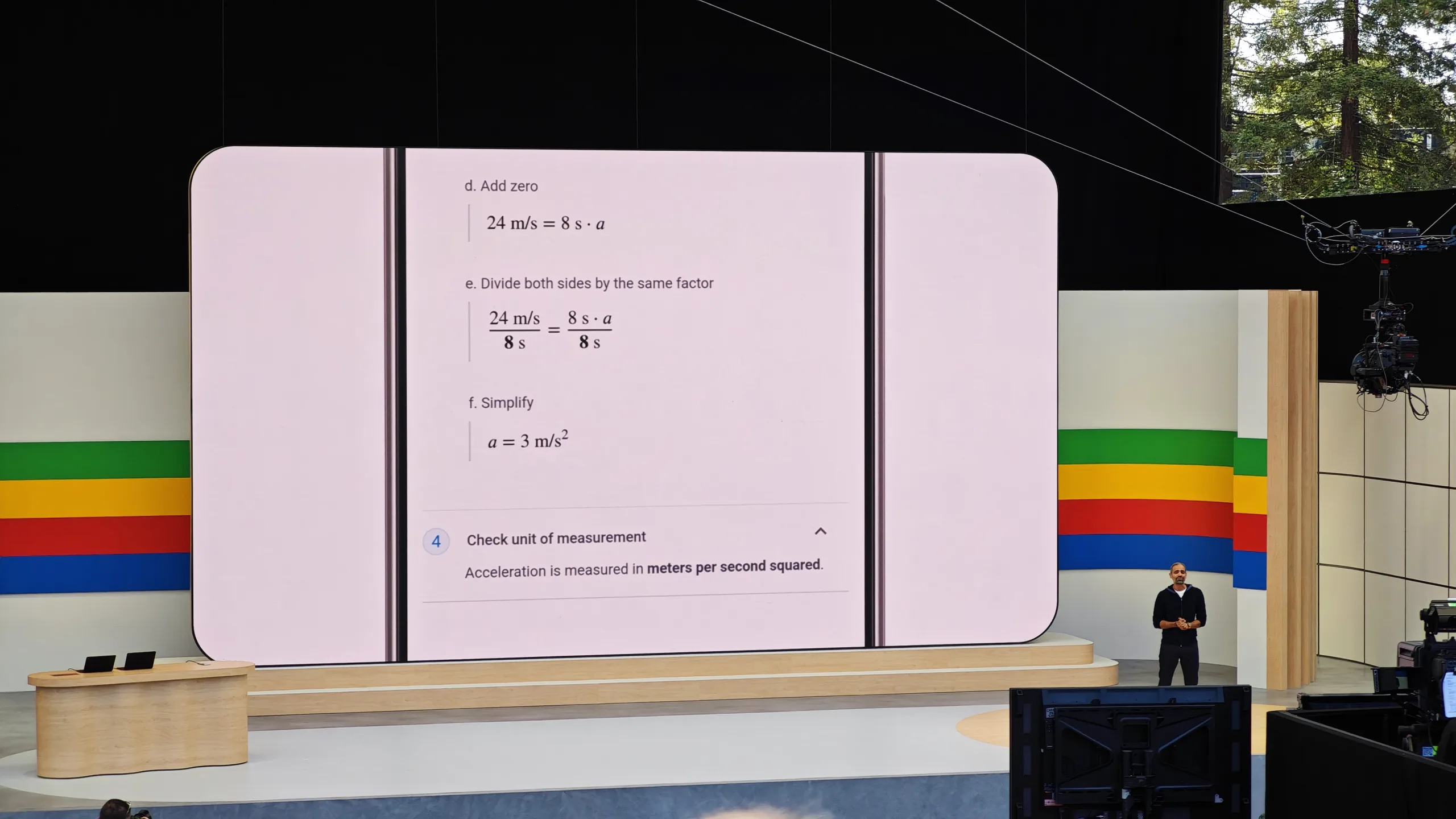

LearnLM, „fein abgestimmt auf das Lernen“

Google hat „LearnLM“ angekündigt, eine auf Gemini basierende Modellfamilie. Das Unternehmen sagt, dass diese Modelle „fein auf das Lernen abgestimmt“ seien, da LearnLM „pädagogische Forschung anwendet“, um Google-Produkte wie die Suche und YouTube persönlicher, aktiver und ansprechender zu machen. Google erwähnte außerdem, dass der neue Lerncoach Gem LearnLM verwendet, um eine „Schritt-für-Schritt-Anleitung zum Lernen“ bereitzustellen. Diese Funktion wird „in den kommenden Monaten“ verfügbar sein.